卷积神经网络的基本结构主要由输入层、卷积层、激活函数层、池化层和全连接层组成。

1. 输入层:接收原始图像数据,将图像转换为像素矩阵。

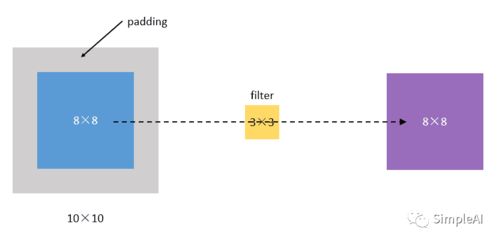

2. 卷积层:通过卷积运算,提取图像的特征。卷积运算主要是通过将一个小的卷积核(也称为滤波器)在图像上滑动,并计算卷积核与图像对应位置的像素值的乘积之和,从而得到新的特征映射。

3. 激活函数层:一般采用ReLU(修正线性单元)函数,用于增加模型的非线性特性,模拟神经元的激活行为。

4. 池化层:通常紧随卷积层和激活函数层之后,主要作用是降采样,减少特征映射的维度,从而减少模型的参数数量和计算复杂度。

5. 全连接层:用于将前面的层次学习到的特征进行整合,输出最终的预测结果。

卷积神经网络的训练过程主要是通过反向传播算法和梯度下降法来不断调整网络的权重参数,使得网络的预测值与实际值之间的误差最小化。在训练过程中,输入数据经过网络的前向传播,计算出预测值,然后与实际值进行比较,计算误差,再通过反向传播算法将误差反向传播回网络,调整权重参数,使得下一次的前向传播能够更接近实际值。

卷积神经网络的最大优势在于其能够自动提取图像的特征,使得模型能够更好地理解图像信息。C还具有参数量少、计算效率高等优点,因此在图像识别、目标检测、人脸识别等领域得到了广泛应用。例如,在图像识别方面,C可以有效地识别出图像中的物体类别和属性;在目标检测方面,C可以通过对图像中的目标进行定位和分类;在人脸识别方面,C可以提取出人脸的特征,实现人脸的识别和认证。

随着深度学习技术的不断发展,C也在不断进化和发展。目前,C的研究主要集中在如何提高模型的识别准确率、如何更好地处理不均匀分布的数据、如何更好地优化模型参数等方面。同时,C也面临着一些挑战,如数据标注成本高、模型泛化能力不足等问题。因此,未来的研究将需要不断探索新的技术和方法,以解决这些问题,推动C的进一步发展。